A Unified Framework For Event-Based Frame Interpolation with Ad-hoc Deblurring in the Wild

发布时间:

2024年11月,课题组博士研究生孙磊论文《A Unified Framework For Event-Based Frame Interpolation with Ad-hoc Deblurring in the Wild》接收于IEEE TPAMI。

期刊介绍

《IEEE Transactions on Pattern Analysis and Machine Intelligence》(IEEE TPAMI)是人工智能、模式识别、计算机视觉等领域的国际顶尖期刊,2023年度最新发布影响因子为24.314,是目前影响因子最高的CCF A类期刊,JCR 1区Top期刊。该期刊谷歌指数(H-Index)在计算机科学和工程技术两个大类学科里均列首位。IEEE TPAMI以严苛的审稿过程、深刻的理论分析著称,每年收录的论文数量有限,在计算机科学与人工智能领域具有权威影响力。

论文主要图表

论文介绍

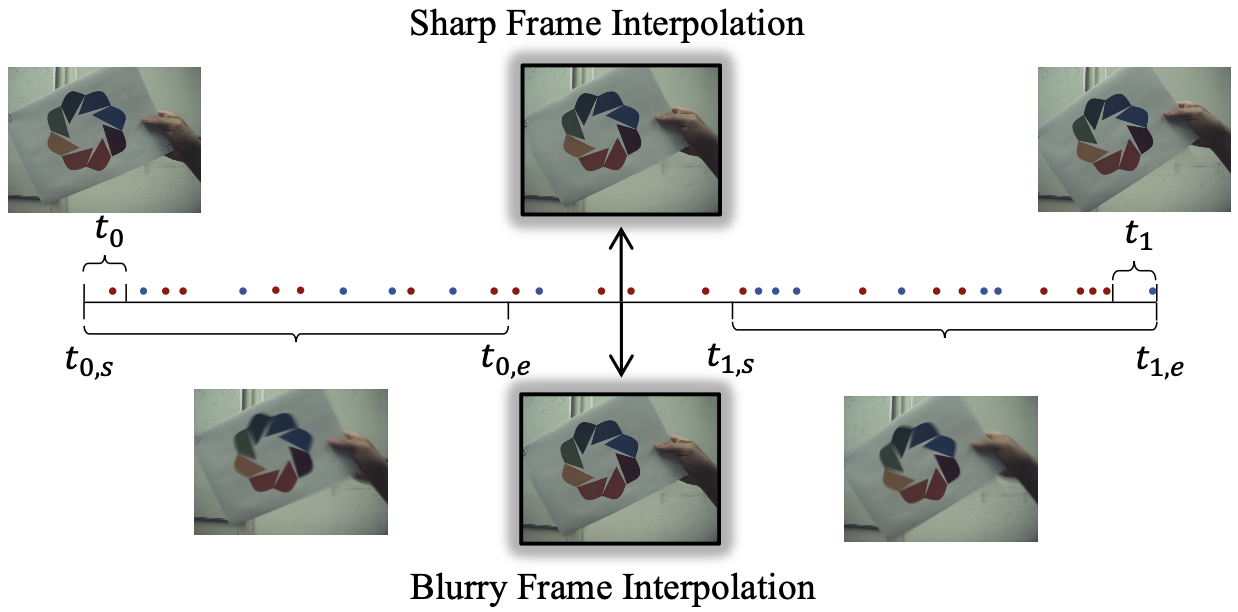

汪凯巍课题组博士研究生孙磊联合苏黎世联邦理工学院计算机视觉实验室Luc Van Gool教授,苏黎世大学机器人传感研究组Davide Scaramuzza教授及其团队成员,完成关于事件相机辅助视频插帧相关研究工作,第一作者为汪凯巍课题组博士研究生孙磊,第一单位为浙江大学。事件相机(Event camera)是一种神经拟态传感器,以稀疏的“事件”记录场景中的光强变化,具有高时间分辨率,高动态范围的优点。传统的视频插帧工作只能单独针对锐利或模糊的视频插帧,而无法统一二者。本工作利用事件相机辅助图像传感器辅助视频插帧的任务,提出的统一框架REFID能够同时解决锐利和模糊的视频插帧,并且在两种任务上都能有目前所有方法中最好的表现。REFID的双向递归网络结果不仅可以解决视频插帧任务,作为副产物,对于单张模糊图像曝光时间内进行插帧,便可以预测帧内的锐利图像,即完成图像去模糊的任务。为了解决仿真数据训练到真实场景测试时出现性能大幅下降的域差异问题,本工作还提出了一个自监督的微调框架,只利用模糊视频图像和事件,无需锐利图像真值便可以微调训练模型,避免了采集配对真值图像的难题,提升了在不同参数,不同型号的传感器上的泛化性。本工作还采集了真实场景下的数据,为目前分辨率最高的事件相机+彩色图像的数据集,在仿真数据集和真实数据集中的广泛实验验证了REFID的领先性能。

该工作首次统一事件辅助的锐利和模糊的视频插帧,对于未来的事件相机辅助图像恢复算法具有启发意义。

BibTeX

@article{sun2024unified,

title={A Unified Framework for Event-based Frame Interpolation with Ad-hoc Deblurring in the Wild},

author={Sun, Lei and Gehrig, Daniel and Sakaridis, Christos and Gehrig, Mathias and Liang, Jingyun and Sun, Peng and Xu, Zhijie and Wang, Kaiwei and Van Gool, Luc and Scaramuzza, Davide},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2024},

publisher={IEEE}

}